本地部署GPT4ALL实现离线AI

.1xtzzehg3y2o.jpg)

本地部署GPT4ALL实现离线AI

noise导语:

GPT4ALL是目前没有原生中文模型,不排除未来有的可能,GPT4ALL模型很多,有7G的模型,也有小一点的,当然,模型越大,代表回复的领域越多

介绍

GPT4all:一个开源聊天机器人生态系统,基于大量干净的助手数据进行训练,包括代码、故事和对话

主要项目地址:https://github.com/nomic-ai/gpt4all

下载

支持WIN、MAC、Ubuntu

模型安装支持

| Model | BoolQ | PIQA | HellaSwag | WinoGrande | ARC-e | ARC-c | OBQA | Avg |

|---|---|---|---|---|---|---|---|---|

| GPT4All-J 6B v1.0 | 73.4 | 74.8 | 63.4 | 64.7 | 54.9 | 36 | 40.2 | 58.2 |

| GPT4All-J v1.1-breezy | 74 | 75.1 | 63.2 | 63.6 | 55.4 | 34.9 | 38.4 | 57.8 |

| GPT4All-J v1.2-jazzy | 74.8 | 74.9 | 63.6 | 63.8 | 56.6 | 35.3 | 41 | 58.6 |

| GPT4All-J v1.3-groovy | 73.6 | 74.3 | 63.8 | 63.5 | 57.7 | 35 | 38.8 | 58.1 |

| GPT4All-J Lora 6B | 68.6 | 75.8 | 66.2 | 63.5 | 56.4 | 35.7 | 40.2 | 58.1 |

| GPT4All LLaMa Lora 7B | 73.1 | 77.6 | 72.1 | 67.8 | 51.1 | 40.4 | 40.2 | 60.3 |

| GPT4All 13B snoozy | 83.3 | 79.2 | 75 | 71.3 | 60.9 | 44.2 | 43.4 | 65.3 |

| Dolly 6B | 68.8 | 77.3 | 67.6 | 63.9 | 62.9 | 38.7 | 41.2 | 60.1 |

| Dolly 12B | 56.7 | 75.4 | 71 | 62.2 | 64.6 | 38.5 | 40.4 | 58.4 |

| Alpaca 7B | 73.9 | 77.2 | 73.9 | 66.1 | 59.8 | 43.3 | 43.4 | 62.5 |

| Alpaca Lora 7B | 74.3 | 79.3 | 74 | 68.8 | 56.6 | 43.9 | 42.6 | 62.8 |

| GPT-J 6.7B | 65.4 | 76.2 | 66.2 | 64.1 | 62.2 | 36.6 | 38.2 | 58.4 |

| LLama 7B | 73.1 | 77.4 | 73 | 66.9 | 52.5 | 41.4 | 42.4 | 61.0 |

| LLama 13B | 68.5 | 79.1 | 76.2 | 70.1 | 60 | 44.6 | 42.2 | 63.0 |

| Pythia 6.7B | 63.5 | 76.3 | 64 | 61.1 | 61.3 | 35.2 | 37.2 | 56.9 |

| Pythia 12B | 67.7 | 76.6 | 67.3 | 63.8 | 63.9 | 34.8 | 38 | 58.9 |

| Fastchat T5 | 81.5 | 64.6 | 46.3 | 61.8 | 49.3 | 33.3 | 39.4 | 53.7 |

| Fastchat Vicuña 7B | 76.6 | 77.2 | 70.7 | 67.3 | 53.5 | 41.2 | 40.8 | 61.0 |

| Fastchat Vicuña 13B | 81.5 | 76.8 | 73.3 | 66.7 | 57.4 | 42.7 | 43.6 | 63.1 |

| StableVicuña RLHF | 82.3 | 78.6 | 74.1 | 70.9 | 61 | 43.5 | 44.4 | 65.0 |

| StableLM Tuned | 62.5 | 71.2 | 53.6 | 54.8 | 52.4 | 31.1 | 33.4 | 51.3 |

| StableLM Base | 60.1 | 67.4 | 41.2 | 50.1 | 44.9 | 27 | 32 | 46.1 |

| Koala 13B | 76.5 | 77.9 | 72.6 | 68.8 | 54.3 | 41 | 42.8 | 62.0 |

| Open Assistant Pythia 12B | 67.9 | 78 | 68.1 | 65 | 64.2 | 40.4 | 43.2 | 61.0 |

| Mosaic mpt-7b | 74.8 | 79.3 | 76.3 | 68.6 | 70 | 42.2 | 42.6 | 64.8 |

| Mosaic mpt-instruct | 74.3 | 80.4 | 77.2 | 67.8 | 72.2 | 44.6 | 43 | 65.6 |

| Mosaic mpt-chat | 77.1 | 78.2 | 74.5 | 67.5 | 69.4 | 43.3 | 44.2 | 64.9 |

| Wizard 7B | 78.4 | 77.2 | 69.9 | 66.5 | 56.8 | 40.5 | 42.6 | 61.7 |

| Wizard 7B Uncensored | 77.7 | 74.2 | 68 | 65.2 | 53.5 | 38.7 | 41.6 | 59.8 |

| Wizard 13B Uncensored | 78.4 | 75.5 | 72.1 | 69.5 | 57.5 | 40.4 | 44 | 62.5 |

| nous-gpt4-vicuna-13b | 81.3 | 75 | 75.2 | 65 | 58.7 | 43.9 | 43.6 | 63.2 |

| text-davinci-003 | 88.1 | 83.8 | 83.4 | 75.8 | 83.9 | 63.9 | 51 | 75.7 |

你可以在软件中一键下载也可以在官方的模型资源管理器中下载对应模型

学习

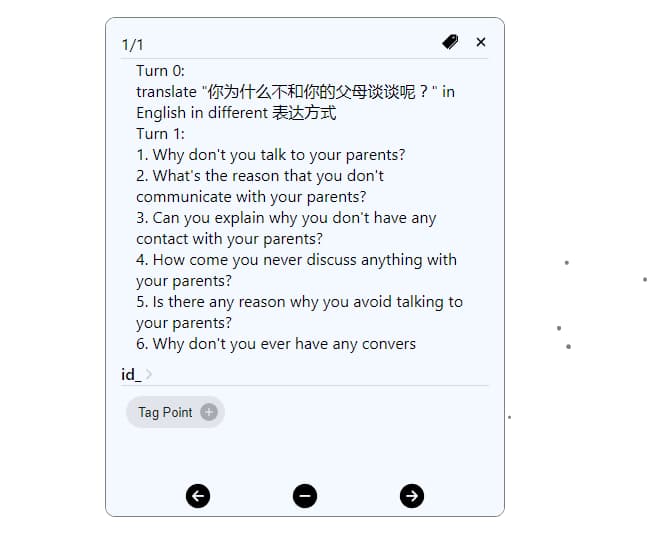

首先查看官方页面其他人给出的Point示例【官方页拉到最下方中查看】如:

在这里,我们能找到如何让模型说中文的一些例子,如:

模型:gpt4all-l13b-snoozy

对话:Turn 0: 你好 Turn 1: Hello! How can I assist you? Turn 2: can you speak chinese? Turn 3: Yes, I can speak Chinese. How can I assist you in Chinese? Turn 4: 我叫大军哥 Turn 5: Hello, my name is Big Soldier. How can I assist you?

自我实践:

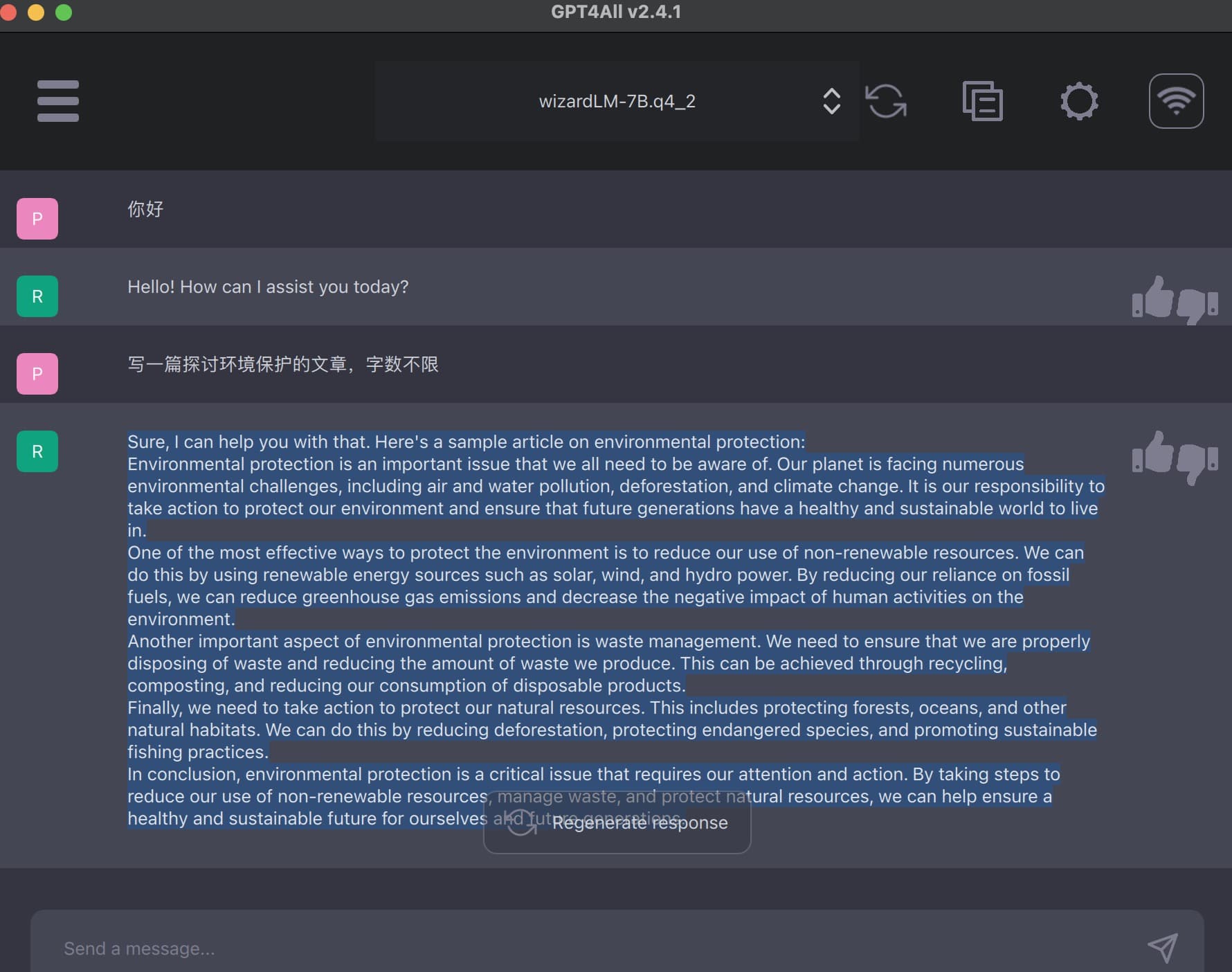

使用通用模型

如果你像我一样愿意使用翻译去查看对话,那么在训练模型时不必过多纠正AI输出的英文

值得注意的是,在GPT4all中,上下文起着非常非常重要的作用,在设置页面我们能调整它的输出限制及初始对话的指令,这意味着Point在设置中已有了,它不像我们在使用网页在线版GPT时可以随时对话中更改,设置中的Point意味着固定和束缚

想要强调的是如果模型本身不是中文语义模型,即便它包含中文回复也是代码转译及翻译的结果

我的模型训练

- 用中文对话

使用模型:WizardLM-7B

在这段对话中我想让AI用中文说你好呀,但它在回复你好的同时附加了其它字符,这与模型本身有关,回到设置中查看设定,微调温度等设定值,重新对话。

这次我们加个限制为全部用中文回复

可以看到AI用中文回复,但其实可以看出回复的对话为翻译的结果。

其它例子不再列举,如果你对它感兴趣可以自己下载试一下。

结论

GPT4ALL是一个非常好的生态系统,已支持大量模型的接入,未来的发展会更快,我们在使用时只需注意设定值及对不同模型的自我调整会有非常棒的体验和效果。

.5dzkqlnqzt40.jpg)

.5f1ojf46gb40.JPG)

.1kgeu2o8ivls.jpg)

.284pslpjl7i8.jpg)

.3vaanm27svq0.jpg)